卷積模型可以用來模擬某些圖像變換,但由於其僅僅是對圖像落入卷積核支撐域的各個局部進行的凸線性變換,限制了它的適用範圍。基於此,我們提出了非線性卷積過程。

基本介紹

- 中文名:非線性卷積層

- 外文名:Nonlinear convolution layer

兩種廣義的非線性卷積

高階卷積

置換卷積

卷積核的估計

高階核估計

置換核估計

卷積模型可以用來模擬某些圖像變換,但由於其僅僅是對圖像落入卷積核支撐域的各個局部進行的凸線性變換,限制了它的適用範圍。基於此,我們提出了非線性卷積過程。

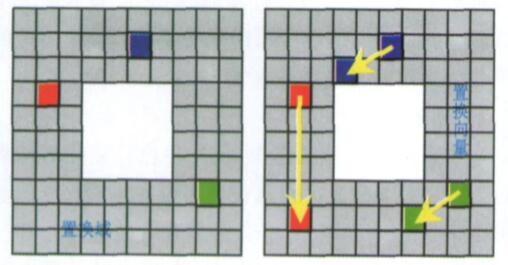

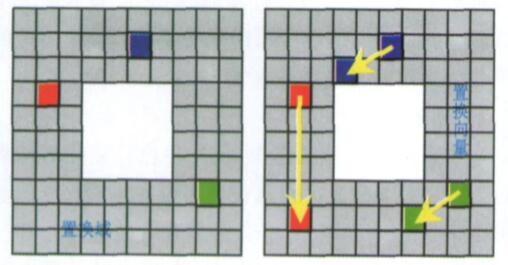

卷積模型可以用來模擬某些圖像變換,但由於其僅僅是對圖像落入卷積核支撐域的各個局部進行的凸線性變換,限制了它的適用範圍。基於此,我們提出了非線性卷積過程。兩種廣義的非線性卷積高階卷積高階卷積在運算中除了考慮圖像的一階變換,...

線性整流層(Rectified Linear Units layer, ReLU layer)使用線性整流(Rectified Linear Units, ReLU) 作為這一層神經的激勵函式(Activation function)。它可以增強判定函式和整個神經網路的非線性特性,而本身並不會改變卷積層。事實上...

第4章卷積神經網路 4.1引言 4.2神經網路層 4.2.1預處理 4.2.2卷積層 4.2.3池化層 4.2.4非線性 4.2.5全連線層 4.2.6轉置卷積層 4.2.7感興趣區域的池化層 4.2.8空間金字塔池化層 4.2.9局部特徵聚合描述符層 4...

深度殘差網路ResNet是一種改進的卷積神經網路,通過引入恆等路徑,降低了模型訓練的難度。在恆等路徑的作用下,網路參數的訓練難度大幅降低,從而容易訓練出效果好的深度學習模型。基本概念 深度殘差收縮網路是一種人工智慧方法,發表在國際...

卷積神經網路 卷積神經網路(Convolutional Neural Network, CNN)是一種前饋神經網路,它的人工神經元可以回響一部分覆蓋範圍內的周圍單元,對於大型圖像處理有出色表現。卷積神經網路由一個或多個卷積層和頂端的全連通層(對應經典的神經...

1x1卷積 作用1:在相同尺寸的感受野中疊加更多的卷積,能提取到更豐富的特徵。這個觀點來自於Network in Network,圖1里三個1x1卷積都起到了該作用。圖2左側是是傳統的卷積層結構(線性卷積),在一個尺度上只有一次卷積;圖2右圖是...

1x1卷積 VGG在最後的三個階段都用到了1x1卷積核,選用1x1卷積核的最直接原因是在維度上繼承全連線,然而作者首先認為1x1卷積可以增加決策函式(decision function,這裡的決策函式就是softmax)的非線性能力,非線性是由激活函式ReLU決定的...

3.2 卷積神經網路 3.2.1 卷積層 3.2.2 非線性激活層ReLU 3.2.3 池化層 3.2.4 全連線層 3.2.5 Softmax歸一化指數層 3.2.6 AlexNet的網路架構 3.3 循環神經網路 附錄 反向傳播算法 實驗實訓二 人臉識別 習...

的參數(或稱權值)做內積,再經過非線性單元計算而來的。這樣的話無論圖片原大小如何,只用F*F個參數就夠了,也就是幾個幾十個的樣子。當然一組 的參數只能得到一張特徵圖,一般會有多組參數,分別經過卷積後就可以有好幾層特徵圖...

3.2.3 輸出層和損失函式45 3.3 卷積神經網路47 3.3.1 卷積操作和卷積層48 3.3.2 實際操作中的卷積層51 3.3.3 非線性激活層52 3.3.4 池化層53 3.3.5 卷積神經網路總體框架53 3.4 循環神經網路54 3.4.1 傳統循環...

本項目針對腦電信號的時空相關性、非平穩性、高維度等特點,設計了深度神經網路和學習算法對其進行非線性時空處理,提取有效特徵。具體展開了以下研究:(1)提出了改進的卷積神經網路用於P300信號檢測。通過在輸入層和卷積層使用批量歸一化...

第4章 卷積神經網路53 4.1卷積神經網路的概念53 4.2卷積神經網路的基本結構54 4.2.1卷積層55 4.2.2池化層56 4.2.3全連線層56 4.3非線性層與激活函式57 4.3.1Sigmoid激活函式57 4.3.2Tanh函式59 4.3.3Relu函式60 4...