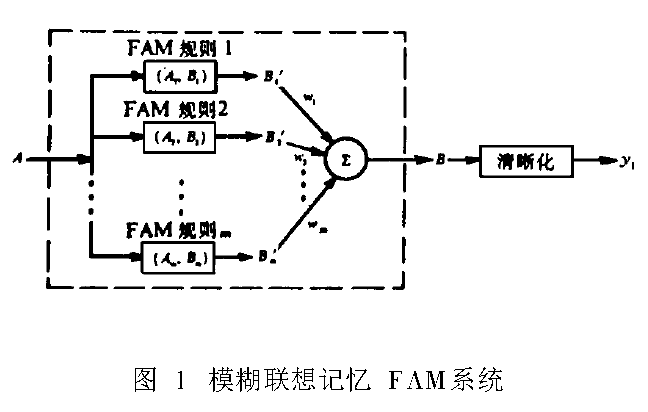

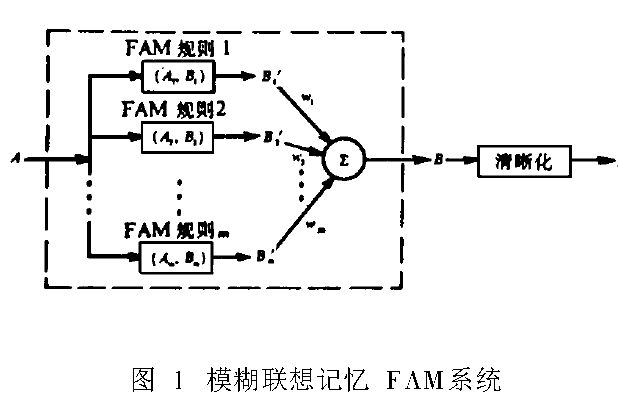

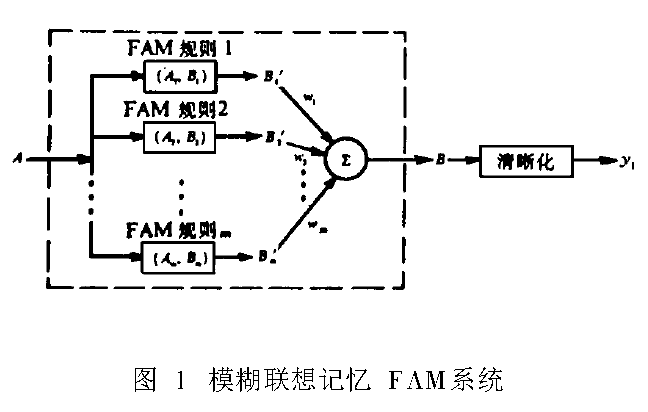

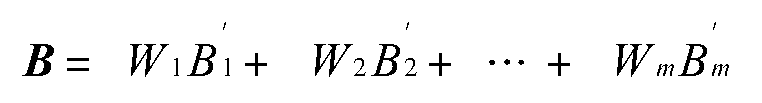

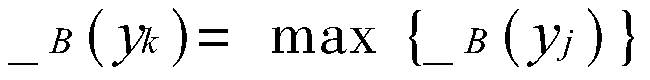

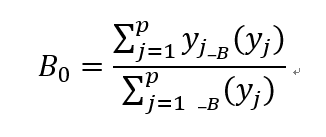

模糊聯想記憶(Fuzzy Associative Memory,簡稱FAM)是通過一定的對應關係將一個論域中的模糊子集映射到另一個論域中,即要將一個立方體映射到另一個立方體,這種映射關係叫做“聯想記憶”,在模糊系統里具體稱為模糊聯想記憶。

基本介紹

- 中文名:模糊聯想記憶

- 外文名:fuzzy associative memory

- 簡稱:FAM

- 學科:控制科學與工程

- 提出者:Kosko

- 提出時間 :1991年

基本概念

模糊聯想記憶模型

模糊聯想記憶推理機

模糊聯想記憶與模糊關係方程

模糊聯想記憶(Fuzzy Associative Memory,簡稱FAM)是通過一定的對應關係將一個論域中的模糊子集映射到另一個論域中,即要將一個立方體映射到另一個立方體,這種映射關係叫做“聯想記憶”,在模糊系統里具體稱為模糊聯想記憶。

模糊聯想記憶(Fuzzy Associative Memory,簡稱FAM)是通過一定的對應關係將一個論域中的模糊子集映射到另一個論域中,即要將一個立方體映射到另一個立方體,這種映射關係叫做“聯想記憶”,在模糊系統里具體...

自適應模糊聯想記憶,是通過一定的對應關係將一個論域中的模糊子集映射到另一個論域中,即要將一個立方體映射到另一個立方體,使這種映射關係與所處理數據的統計分布特徵、結構特徵相適應,以取得最佳處理處效果的過程。自適應模糊聯想...

《模糊聯想記憶網路理論及其在圖象恢復技術中的套用》是依託中國人民解放軍國防科技大學,由劉普寅擔任項目負責人的面上項目。中文摘要 對模糊聯想記憶網路的結構及性能做系統的研究,尋求圖象恢復技術中比前人更有效的處理方法。主要包括(1...

SAM 屬於情景記憶模型,TODAM 為語義記憶模型,Matrix模型為情景記憶與語義記憶的混合模型。聯想記憶的原理及算法 Hopfield模型具有與人腦聯想記憶類似的能力。它能夠從缺損或模糊不清的圖象中聯想起記憶中完整、清晰的圖象來,但這種模型在...

第十一章 模糊聯想記憶網路 11.1模糊記憶與模糊聯想存儲器 11.1.1模糊自聯想存儲器 11.1.2模糊異聯想存儲器 11.2模糊異聯想存儲器多模式對聯想存儲學習算法的最佳化 11.2.1模糊赫布型學習規則的特徵與不足 11.2.2多模式對聯想...

ANFIS是將 Sugeno一階模糊推理系統以網路的形式來實現時而得到的一種神經網路,同樣有以任意精度逼近任何線性或非線性函式的功能,使ANFIS運用於非線性系統辨識成為可能。B樣條模糊神經網路屬於聯想記憶網路,由於B樣條函式具有最小局部正支撐...

8.2模糊聯想記憶 8.3模糊極小―極大神經網路 8.4模糊關係神經網路 8.5模糊Hopfielld神經網路 8.6模糊推理的基於h-水平截集的模糊神經網路 8.7模糊邏輯系統的基於正規化模糊神經網路的實現 8.8用模糊神經網路來修正不完善的模糊...

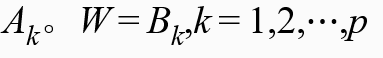

§12.1模糊聯想記憶網路及其基本問題 §12.2基本概念與簡要回顧 §12.3 FBAM的收斂性 §12.4 FBAM的吸引子及其穩定性分析 §12.5 FBAM的學習算法 §12.6 由max-min學習規則確定的FBAM §12.7 FBAM的容量分析 第13章 ...

聯想記憶是記憶的一種形式。通過與其他的知識單元的聯繫進行的記憶。相互之間存在聯繫的形式或概念構成知識在記憶中的具體形態。有兩個特點:一般是一對多的聯合關係的記憶;根據關鍵字按內容進行存儲。在心理學研究中,美國心理學家J.R....

本項目提出了在信息處理中採用模糊系統理論解決傳統理論及算法實踐中碰到的模糊概念問題,光從模糊理論中模糊熵原理出發研究模糊系統理論與機率理論概念的異同及意義,然後建立模糊規劃的聯想記憶模型及算法體系。主要研究成果包括:1、為一種...

2.13基本語言值的關係及其對模糊控制器設計的指導意義 2.14自適應模糊控制的仿真研究 第三章 模糊神經網路理論研究與套用 3.1並行遺傳算法與神經網路、模糊系統的結合 3.2遺傳算法在T-S模糊模型辨識中的套用 3.3正則模糊聯想記憶 3...

模組聯想 第二篇:五爪金龍單詞記憶法 第一爪:找單詞(熟詞法)第二爪:找拼音(拼音法)第三爪:找字母(字母編碼法)第四爪:找諧音(諧音法)第五爪:找特點(模糊記憶法)第三篇:單詞記憶法的靈活運用 模組為聯想服務 精確...

§2.4 Hopfield聯想記憶模型 §2.5 利用外積和的雙極性Hopfield網路 §2.6 Hopfield網路的存儲容量 §2.7 Hopfield網路的收斂性 §2.8 二次最佳化問題的Hopfield網路解法 §2.9 雙向聯想記憶(BAM)網路 §2.10 模糊聯想記憶(FAM...