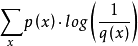

交叉熵(Cross Entropy)是Shannon資訊理論中一個重要概念,主要用於度量兩個機率分布間的差異性信息。語言模型的性能通常用交叉熵和複雜度(perplexity)來衡量。交叉熵的意義是用該模型對文本識別的難度,或者從壓縮的角度來看,每個詞平均要用幾個位來編碼。複雜度的意義是用該模型表示這一文本平均的分支數,其倒數可視為每個詞的平均機率。平滑是指對沒觀察到的N元組合賦予一個機率值,以保證詞序列總能通過語言模型得到一個機率值。通常使用的平滑技術有圖靈估計、刪除插值平滑、Katz平滑和Kneser-Ney平滑。

基本介紹

- 中文名:交叉熵

- 外文名:Cross Entropy

- 用途:機器學習,語言模型等

- 類型:計算機語言學

- 學科:資訊理論

- 發展實踐:1979

- 意義:計算語言學消岐的一種有效工具

介紹