基本介紹

- 外文名:MuZero

- 開發者:DeepMind

背景,特點,戰果,意義,

背景

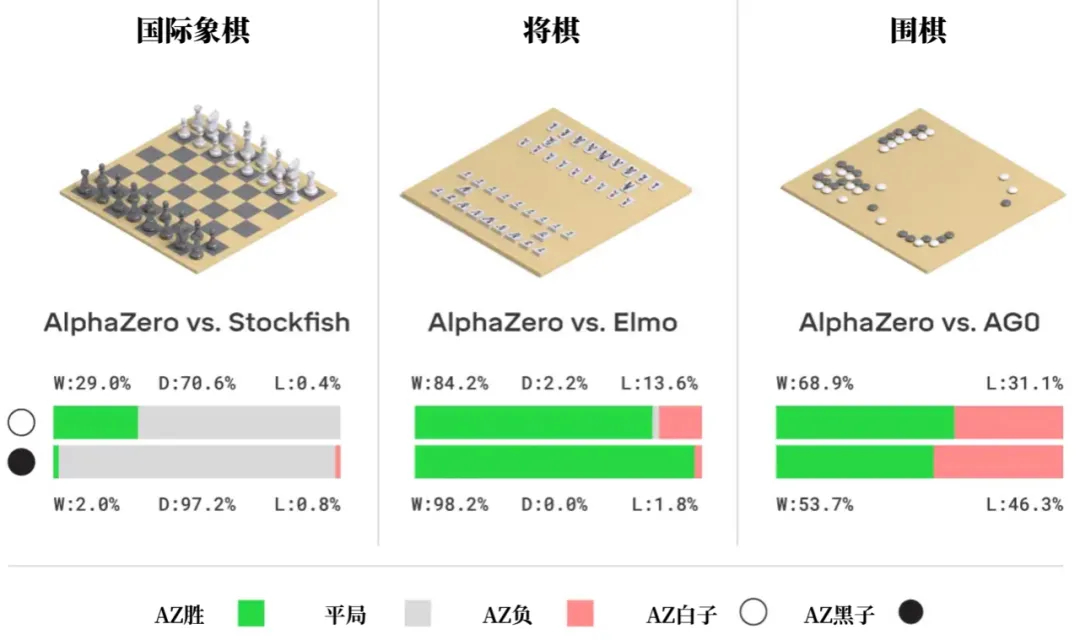

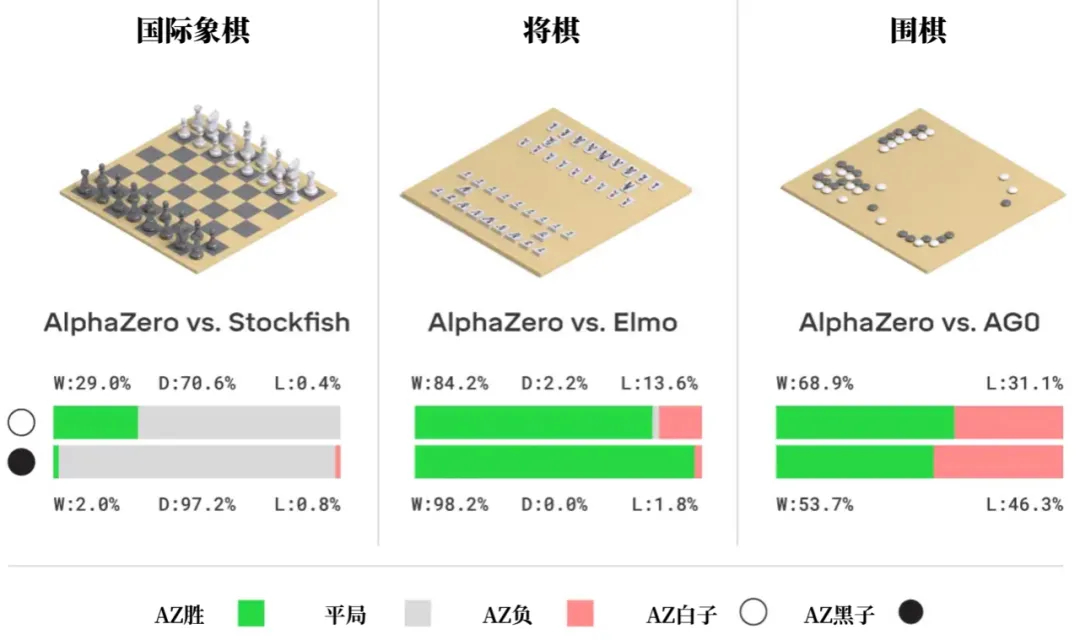

如果說AlphaGo的成功確立了AI的“圍棋霸權”,隨後的AlphaGo Zero和AlphaZero則進一步揭示了“棋類霸權”的可能性。作為AI算法,不論是AlphaGo還是其繼位者,都需要大量的訓練。AlphaGo依賴於專家棋法(expert moves)數據集,而AlphaGo Zero捨去了這一步,直接與自己對戰以為訓練提供數據。AlphaZero則除了圍棋,更學會了日本象棋(將棋)和西洋棋。值得一提的是,2018年底發布的AlphaZero,從第一次見到棋盤,到成為世界級棋類大師,只用了24小時。

MuZero

2020年,DeepMind發表了MuZero。

特點

自古以來,哲學家和科學家都幻想著有朝一日能造出“人工通用智慧型”(artificial general intelligence)。簡單地說,人工通用智慧型需要有極高的可塑性(flexibility),從而適應(甚至精通)各式不同的任務:一個能下棋、玩遊戲、做家務、開飛機的AI。然而在此之前,最好的AI算法也只能精通數個同類任務;會下圍棋、將棋和西洋棋的AlphaZero就是一個例子。

這種限制,在很大程度上來自AI算法對規則的依賴性。要想讓AlphaZero下好各種棋,人類需要明確地教它各種棋的規則。以西洋棋為例,AlphaZero知道象只能斜著走,還不能跨過障礙物,而馬可以跨過障礙物,但需要走“日”字。AlphaZero也知道什麼是輸贏和平局。可是一旦更換棋種,人類就需要將新棋種的規則從頭教給AlphaZero。

AlphaZero(簡稱AZ)對戰各個此前最強的棋類AI

既然這種依賴性限制了目前AI算法的套用範圍,那最簡單的解決方案,就是去除這種依賴性:人類可以不教AI下棋,只給它一個棋盤。每當AI選擇了下一步該如何走時,人類才告訴它這一步合不合法,並且是否導致了輸贏或平局。

——這就是MuZero面臨的情境。對於任何一個遊戲或任務,MuZero所掌握的只有一套“思考方式”,並沒有該任務的“行為準則”。它不知道西洋棋里的馬該怎么走,也不知道將棋中如何達成“王手”。如同第一次見到電腦的小孩,MuZero具有作出推理論斷的“思維工具”,但不知道如何才能贏得“掃雷”。

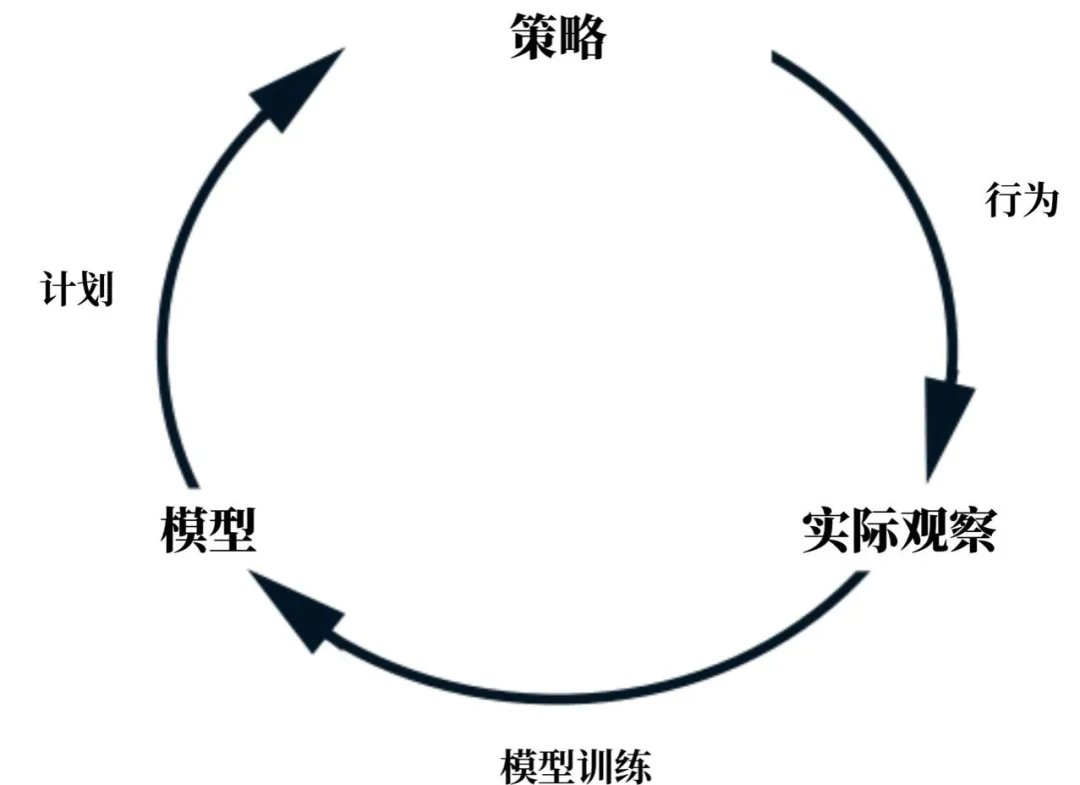

跟人類一樣,MuZero的秘訣,在於摸著石頭過河,為外部世界建立一個只屬於自己的“模型”(internal model)。在這個內部模型中,MuZero捨棄了一切表面上的規則,只留下對決策有用的信息:價值(value,即當前決策“有多好”)、策略(policy,即最好的“下一步”是什麼)和獎勵(reward,即上一步“有多好”)。

MuZero為外部世界建立模型從而指導自己在不同任務中的策略

要明白這種策略的特殊和有效性,我們可以拿MuZero和AlphaZero的神經網路作對比:

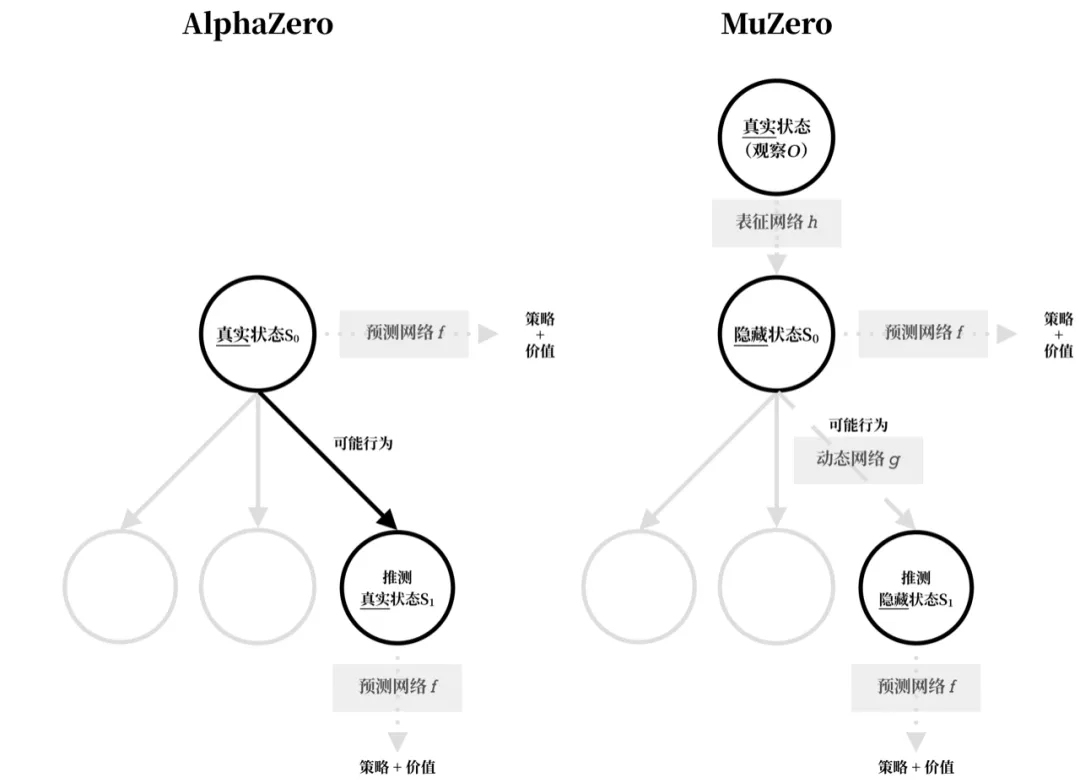

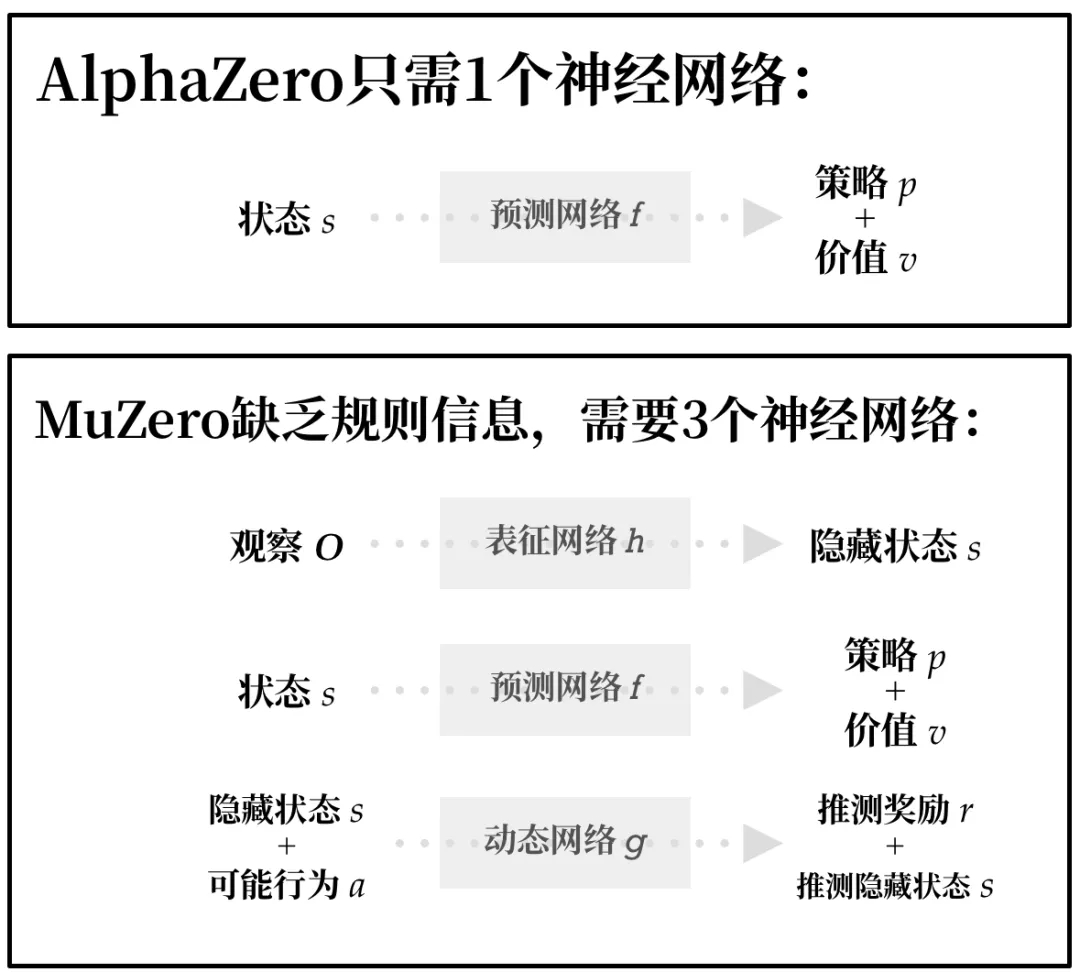

任何深度學習算法在面對棋盤時,第一步總是觀察。AlphaZero能觀察當前棋局(S0),並直接利用S0計畫未來的棋步。這要多虧了它所知道的棋類規則:它明白做出一個動作(action)後的下一個棋局長什麼樣,並可以在下一個棋局的基礎上繼續規劃棋路,“想像”並評估各種不同的可能性。這樣的規劃方式,在深度學習上稱為“蒙特卡洛樹搜尋”(Monte Carlo tree search,MCTS)。MCTS允許算法探索不同的可能性,並從中擇出最優的動作。因此,熟知規則的AlphaZero要想精通棋類,只需要一個“神經網路”(neural network),即“預測網路”(prediction network)f,給f輸入一個狀態,它就能給出這個狀態的價值(v)和潛在策略(p);通過評估各個可能性,AlphaZero就能得知當前最好的棋步。

MuZero則沒有這種“奢華待遇”:它需要摸索出棋盤上各個子的合法(legal)走法,還需要弄清輸贏的概念;當然,它的目標與AlphaZero一樣,贏就好了,越多越好。但在不清楚規則的情況下,MuZero需要另闢蹊徑,利用“表征網路”(representation network)h,將觀察到的棋盤狀態轉換成只屬於自己的隱藏狀態(hidden state)。我們將當前的棋盤狀態稱為“O”(observation,即觀察),MuZero的當前隱藏狀態稱為S0。但這時,MuZero遇到了第二個大難題:如何像AlphaZero一樣評估未來的各種可能性呢?

不像AlphaZero,不知道棋盤規則的MuZero不能預測棋盤的各種可能狀態,因此,MuZero需要從零開始,創造自己對棋路的內部模型。幸運的是,有了隱藏狀態S0之後,MuZero就能算出S0狀態下可以做出的各種行動(經過學習,MuZero得出的可能行動會越來越符合規則),並能通過“動態網路”(dynamic network)g,利用MuZero選擇的行動和當前潛在狀態S0,推演出S1。在每一個真實世界的時間點內,MuZero都能利用自己的內部模型和MCTS選擇出這一個時間點的最佳行為,並將其套用於真實世界中。在實際做出了一個最佳行為後,這個行為又能再“回收”,用於訓練動態網路g(從而改進MuZero的內部模型)。

AlphaZero和MuZero

圖為AlphaZero和MuZero MCTS方法的並列對比。熟知規則的AlphaZero能由一個真實狀態和可能行為,推測下一個真實狀態。而MuZero由於不知道遊戲規則,只能將真實狀態表征為隱藏狀態,學會建立自己的內在模型。

也就是說,由於AlphaZero對規則的掌握,它只需要一個預測網路f就能精通棋類。而不能預先知曉規則的MuZero,則需要利用動態網路g和表征網路h,自己學習並建立一個內在模型,從而學會下棋。在建立內在模型的過程中,人類不會給MuZero設定任何限制:MuZero可以捨棄任何信息,只保留有用的元素(即價值、策略和獎勵)。

MuZero需要3個神經網路來建立內部模型,從而指導精確規劃

與人類一樣,MuZero可以在它的“腦海”中創造任何規則和動態。它的目標是做出最精確、最有效的未來規劃。捨棄了"循規蹈矩"的MuZero反而因此獲得了極強的可塑性,在截然不同的棋類和電腦遊戲中都"得心應手"。

戰果

就這樣,MuZero這樣一個“無師自通”的算法,竟然在AlphaZero引以為傲的棋類遊戲中輕鬆與後者打成了平手。

戰果

在西洋棋、將棋和圍棋中,MuZero的表現(藍線)達到甚至超過了AlphaZero(橙線)。而在雅達利遊戲“吃豆人小姐”中,MuZero的表現(藍線)遠超此前表現最佳的R2D2算法得分(橙線)。

在西洋棋、將棋和圍棋中,MuZero都能達到AlphaZero的水平,甚至在圍棋中稍稍勝過了AlphaZero。這表明MuZero“自學成才”建立的內部模型,或許比AlphaZero的“循規蹈矩”更接近圍棋的要義。在雅達利遊戲中,MuZero的表現也非同尋常。以“吃豆人小姐”(Ms. Pac-Man)為例,MuZero的得分為243401.10,相比之下,人類的最高分只有6951.60,是MuZero的1/35。在57個測試用的雅達利遊戲中,MuZero在37箇中取得了歷史最高分,而人類則僅在5個遊戲中保持著最佳成績。

意義

在利用AlphaZero和其他算法攻破了這些遊戲後,反而對MuZero隱藏起規則,讓它“閉上眼”下棋、“背著手”玩遊戲的目的是什麼呢?

DeepMind和整個AI領域一樣,並不在乎西洋棋和雅達利遊戲本身。這是一場事關智慧型的征途,目標是理解智慧型本身。牙牙學語的嬰兒並不明白動名詞的區別,卻能在短短几個月內連詞成句,甚至創造出只屬於他們的句子。生物學家也並非生來就知曉細胞的各種秘密,而是在實驗和失敗中,一步步對生物世界建立了理論和模型,從而獲得深刻洞見。

事實很殘酷:循規蹈矩不是智慧型。事先熟知規則再精通下棋,與先摸索規則、建立內部模型再精通棋路是全然不同的。前者只能困於“棋”中,後者則能將一套“思考方式”搬到各種任務上。前者的例子包括AlphaGo到AlphaZero的各種棋類AI,後者則包括MuZero和于爾根·施密德胡波(Jürgen Schmidhuber)著名的“循環世界模型”(Recurrent World Model)。

為外界建立內部表征是人類最引以為傲的能力之一。如今在AI身上,這個能力再次證明了自己的價值。MuZero不僅讓人類看到了創造人工通用智慧型的可能性,還為我們打開了一扇通往智慧型本身的大門。