專利背景

隨著監控攝像頭越來越普及,通過攝像頭對重點場景的安防監控的需求也越來越普及。安防監控需求中最急切的是對於人員的異常聚集的監控和警示。如果一個場景中人流密度過高,存在發生踩踏等危險事故的風險。因此,對監控場景中的人員密度、人群流量的監控和預測對城市安全有著非常重要的套用價值。

截至2016年6月,傳統的安防監控主要通過人力來監控每一個攝像頭,但是隨著攝像頭數量的指數級增長,這樣會耗費很多人力資源。另外,人工的判定標準可能依賴主觀經驗,不能準確的量化當前的擁擠程度,從而做出正確的決策。因此通過機器智慧型系統自動判定每一個場景的擁擠程度就有非常重要的價值。然而,傳統的人群擁擠判定算法往往針對於特定場景,依賴特定場景中的透視變換,以及場景中的背景建模和幾何信息。當需要更換場景時,就需要重新的適配,因此為特定場景訓練好的監控模型沒有可推廣性。

發明內容

專利目的

《視頻監控方法和視頻監控設備》提供了一種視頻監控方法和使用該視頻監控方法的視頻監控設備。通過基於行人檢測的思想,對場景中的每個位置來做量化的密度估計,並且利用反饋神經網路結合時序信息進行當前時刻的人群密度估計以及未來的人群密度判斷,實現了獨立於場景的人群密度估計。

技術方案

根據《視頻監控方法和視頻監控設備》的一個實施例,提供了一種視頻監控方法,包括:獲取經由視頻數據採集模組採集的視頻數據;將所述視頻數據的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息;以及利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,預測所述待預測幀中的每個像素點的對象密度信息。

此外,根據《視頻監控方法和視頻監控設備》的一個實施例的視頻監控方法,還包括:訓練所述第一神經網路,其中,所述訓練所述第一神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,利用預定形狀的標註框標註所述至少一幀中存在的訓練對象,將標註後的視頻數據作為第一訓練數據,所述第一訓練數據的每個像素點的濃度指示所述每個像素點處存在的訓練對象的數量;以及將所述第一訓練數據的每一幀輸入至卷積神經網路,輸出所述第一訓練數據的每一幀中每個像素點的所述訓練對象的數量;根據輸出的所述訓練對象的數量和標註的所述訓練對象的數量,計算第一損失函式,根據所述第一損失函式調整所述卷積神經網路的參數,以得到訓練好的所述第一神經網路。

此外,根據《視頻監控方法和視頻監控設備》的一個實施例的視頻監控方法,還包括:訓練所述第二神經網路,其中,所述訓練所述第二神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第二訓練數據,並根據每個場景的場景信息標註所述第二訓練數據中每個像素點的訓練對象的密度;將所述第二訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述第二訓練數據的所述每一幀中每個像素點的訓練對象數的密度;根據每一幀的輸出的訓練對象的密度和所述第二訓練數據中的對應幀中的標註的訓練對象的密度,計算第二損失函式;根據所述第二損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

此外,根據《視頻監控方法和視頻監控設備》的一個實施例的視頻監控方法,還包括:訓練所述第二神經網路,其中,所述訓練所述第二神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第三訓練數據,並根據每個場景的場景信息標註所述第三訓練數據中每個像素點的訓練對象的密度;將所述第三訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點處的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述每一幀之後的待預測幀中每個像素點的訓練對象數量的密度;根據輸出的所述待預測幀中每個像素點的訓練對象的密度和所述第三訓練數據中的對應幀中標註的訓練對象的密度,計算第三損失函式;根據所述第三損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

此外,根據《視頻監控方法和視頻監控設備》的一個實施例的視頻監控方法,其中所述將所述視頻數據的至少一幀輸入至第一神經網路,以確定所述視頻數據的至少一幀中每個像素點的對象數量信息包括:基於預定模型或預定算法,確定所述至少一幀中的前景數據和背景數據,以及將所述前景數據輸入至所述第一神經網路,從而確定所述前景數據中每個像素點的對象數量信息。

此外,根據《視頻監控方法和視頻監控設備》的一個實施例的視頻監控方法,其中,所述至少一幀為所述視頻數據中的全部圖像幀;或者,所述至少一幀為所述視頻數據中的部分圖像幀,並且當所述至少一幀中的幀數大於等於三幀時相鄰的各幀之間的時間間隔相同。

此外,根據《視頻監控方法和視頻監控設備》的一個實施例的視頻監控方法,其中,在所述確定所述至少一幀中每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息;和/或,在所述預測所述待預測幀中的每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息。

此外,根據《視頻監控方法和視頻監控設備》的一個實施例的視頻監控方法,還包括:在所述至少一幀或所述至少一幀之後的待預測幀的所述對象密度信息指示所述對象密度超過預定閾值時,生成提示信息。

根據《視頻監控方法和視頻監控設備》的另一個實施例,提供了一種視頻監控設備,包括:視頻數據獲取模組,用於獲取採集場景的視頻數據;數量確定模組,將所述視頻數據中的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息;以及密度確定模組,利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,預測所述待預測幀中的每個像素點的對象密度信息。

此外,根據《視頻監控方法和視頻監控設備》的另一個實施例的視頻監控設備,還包括:第一訓練模組,用於預先訓練所述第一神經網路,其中,對於多個採集場景中的每個場景的視頻數據的至少一幀,利用預定形狀的標註框標註所述至少一幀中存在的訓練對象,將標註後的視頻數據作為第一訓練數據,所述第一訓練數據的每個像素點的濃度指示所述每個像素點處存在的訓練對象的數量,所述第一訓練模組將所述第一訓練數據的每一幀輸入至卷積神經網路,輸出所述第一訓練數據的每一幀中每個像素點的訓練對象的數量;所述第一訓練模組根據輸出的所述訓練對象的數量和標註的所述訓練對象的數量,計算第一損失函式,並根據所述第一損失函式調整所述卷積神經網路的參數,以得到訓練好的所述第一神經網路。

此外,根據《視頻監控方法和視頻監控設備》的另一個實施例的視頻監控設備,還包括:第二訓練模組,所述第二訓練模組用於訓練所述第二神經網路,其中,對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第二訓練數據,並根據每個場景的場景信息標註所述第二訓練數據中每個像素點的密度,所述第二訓練模組將所述第二訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點處的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述第二訓練數據的所述每一幀中每個像素點的訓練對象的密度,所述第二訓練模組根據每一幀的輸出的訓練對象的密度和所述第二訓練數據中的對應幀中的標註的訓練對象的密度,計算第二損失函式,並根據所述第二損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

此外,根據《視頻監控方法和視頻監控設備》的另一個實施例的視頻監控設備,還包括:第三訓練模組,所述第三訓練模組用於訓練所述第二神經網路,其中,對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第三訓練數據,並根據每個採集場景的場景信息標註所述第三訓練數據中每個像素點的密度,所述第三訓練模組將所述第三訓練數據的每一幀輸入至第二神經網路,並根據所述第二訓練數據中的每一幀的之前幀中的每個像素點處的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述第三數據的每一幀之後的待預測幀中每個像素點的訓練對象數量的密度,所述第三訓練模組根據輸出的所述待預測幀中每個像素點的訓練對象的密度和所述第三訓練數據中的對應幀中標註的訓練對象的密度,計算第三損失函式,並根據所述第三損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

此外,根據《視頻監控方法和視頻監控設備》的另一個實施例的視頻監控設備,其中所述數量確定模組基於預定模型或預定算法,確定所述視頻數據中的所述至少一幀中的前景數據和背景數據,並且將所述前景數據輸入至所述第一神經網路,從而確定所述前景數據中每個像素點的對象數量信息。

此外,根據《視頻監控方法和視頻監控設備》的另一個實施例的視頻監控設備,其中,所述至少一幀為所述視頻數據中的全部圖像幀;或者,所述至少一幀為所述視頻數據中的部分圖像幀,並且當所述至少一幀中的幀數大於等於三幀時相鄰的各幀之間的時間間隔相同。

此外,根據《視頻監控方法和視頻監控設備》的另一個實施例的視頻監控設備,其中,所述密度確定模組在確定所述至少一幀中每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息;和/或,所述密度確定模組在預測所述待預測幀中的每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息。

此外,根據《視頻監控方法和視頻監控設備》的另一個實施例的視頻監控設備,還包括:信息生成模組,用於在所述至少一幀或所述至少一幀之後的待預測幀的所述對象密度信息指示所述對象密度超過預定閾值時,生成提示信息。

根據《視頻監控方法和視頻監控設備》的又一個實施例,提供了一種電腦程式產品,包括計算機可讀存儲介質,在所述計算機可讀存儲介質上存儲了電腦程式指令,所述電腦程式指令在被計算機運行時,使得所述計算機執行以下步驟:

獲取經由視頻數據採集模組採集的視頻數據;將所述視頻數據的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息;以及利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,預測所述待預測幀中的每個像素點的對象密度信息。

附圖說明

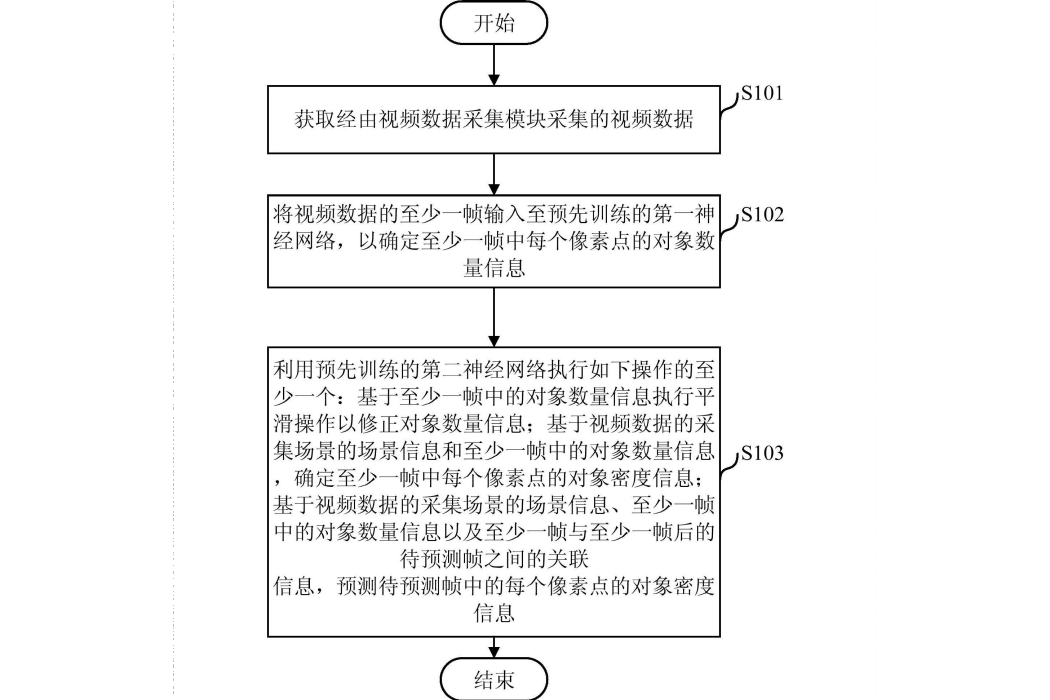

圖1是概述根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法的流程圖。

圖2是圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的功能性框圖。

圖3是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理的第一流程圖。

圖4是圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理中訓練數據標註的示意圖。

圖5是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理的第二流程圖。

圖6是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理的第三流程圖。

圖7是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的功能性框圖。

圖8是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法的流程圖。

圖9是圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的示意性框圖。

技術領域

《視頻監控方法和視頻監控設備》涉及視頻監控領域,更具體地,涉及視頻監控方法和使用該視頻監控方法的視頻監控設備。

權利要求

1.一種視頻監控方法,包括:獲取經由視頻數據採集模組採集的視頻數據;將所述視頻數據的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息;以及利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,預測所述待預測幀中的每個像素點的對象密度信息。

2.如權利要求1所述的視頻監控方法,還包括:訓練所述第一神經網路,其中,所述訓練所述第一神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,利用預定形狀的標註框標註所述至少一幀中存在的訓練對象,將標註後的視頻數據作為第一訓練數據,所述第一訓練數據的每個像素點的濃度指示所述每個像素點處存在的訓練對象的數量;以及將所述第一訓練數據的每一幀輸入至卷積神經網路,輸出所述第一訓練數據的每一幀中每個像素點的所述訓練對象的數量;根據輸出的所述訓練對象的數量和標註的所述訓練對象的數量,計算第一損失函式,根據所述第一損失函式調整所述卷積神經網路的參數,以得到訓練好的所述第一神經網路。

3.如權利要求1所述的視頻監控方法,還包括:訓練所述第二神經網路,其中,所述訓練所述第二神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第二訓練數據,並根據每個場景的場景信息標註所述第二訓練數據中每個像素點的訓練對象的密度;將所述第二訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述第二訓練數據的所述每一幀中每個像素點的訓練對象數的密度;根據每一幀的輸出的訓練對象的密度和所述第二訓練數據中的對應幀中的標註的訓練對象的密度,計算第二損失函式;根據所述第二損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

4.如權利要求1所述的視頻監控方法,還包括:訓練所述第二神經網路,其中,所述訓練所述第二神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第三訓練數據,並根據每個場景的場景信息標註所述第三訓練數據中每個像素點的訓練對象的密度;將所述第三訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點處的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述每一幀之後的待預測幀中每個像素點的訓練對象數量的密度;根據輸出的所述待預測幀中每個像素點的訓練對象的密度和所述第三訓練數據中的對應幀中標註的訓練對象的密度,計算第三損失函式;根據所述第三損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

5.如權利要求1所述的視頻監控方法,其中所述將所述視頻數據的至少一幀輸入至第一神經網路,以確定所述視頻數據的至少一幀中每個像素點的對象數量信息包括:基於預定模型或預定算法,確定所述至少一幀中的前景數據和背景數據;以及將所述前景數據輸入至所述第一神經網路,從而確定所述前景數據中每個像素點的對象數量信息。

6.如權利要求1所述的視頻監控方法,其中,所述至少一幀為所述視頻數據中的全部圖像幀;或者,所述至少一幀為所述視頻數據中的部分圖像幀,並且當所述至少一幀中的幀數大於等於三幀時相鄰的各幀之間的時間間隔相同。

7.如權利要求1所述的視頻監控方法,其中,在所述確定所述至少一幀中每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息;和/或,在所述預測所述待預測幀中的每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息。

8.如權利要求1到7的任一項所述的視頻監控方法,還包括:在所述至少一幀或所述至少一幀之後的待預測幀的所述對象密度信息指示所述對象密度超過預定閾值時,生成提示信息。

9.一種視頻監控設備,包括:視頻數據獲取模組,用於獲取採集場景的視頻數據;數量確定模組,將所述視頻數據中的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息;以及密度確定模組,利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的時間關係信息,預測所述待預測幀中的每個像素點的對象密度信息。

10.如權利要求9所述的視頻監控設備,還包括:第一訓練模組,用於預先訓練所述第一神經網路,其中,對於多個採集場景中的每個場景的視頻數據的至少一幀,利用預定形狀的標註框標註所述至少一幀中存在的訓練對象,將標註後的視頻數據作為第一訓練數據,所述第一訓練數據的每個像素點的濃度指示所述每個像素點處存在的訓練對象的數量,所述第一訓練模組將所述第一訓練數據的每一幀輸入至卷積神經網路,輸出所述第一訓練數據的每一幀中每個像素點的訓練對象的數量;所述第一訓練模組根據輸出的所述訓練對象的數量和標註的所述訓練對象的數量,計算第一損失函式,並根據所述第一損失函式調整所述卷積神經網路的參數,以得到訓練好的所述第一神經網路。

11.如權利要求9所述的視頻監控設備,還包括:第二訓練模組,所述第二訓練模組用於訓練所述第二神經網路,其中,對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第二訓練數據,並根據每個場景的場景信息標註所述第二訓練數據中每個像素點的密度,所述第二訓練模組將所述第二訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點處的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述第二訓練數據的所述每一幀中每個像素點的訓練對象的密度,所述第二訓練模組根據每一幀的輸出的訓練對象的密度和所述第二訓練數據中的對應幀中的標註的訓練對象的密度,計算第二損失函式,並根據所述第二損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

12.如權利要求9所述的視頻監控設備,還包括:第三訓練模組,所述第三訓練模組用於訓練所述第二神經網路,其中,對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第三訓練數據,並根據每個採集場景的場景信息標註所述第三訓練數據中每個像素點的密度,所述第三訓練模組將所述第三訓練數據的每一幀輸入至第二神經網路,並根據所述第二訓練數據中的每一幀的之前幀中的每個像素點處的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述第三數據的每一幀之後的待預測幀中每個像素點的訓練對象數量的密度,所述第三訓練模組根據輸出的所述待預測幀中每個像素點的訓練對象的密度和所述第三訓練數據中的對應幀中標註的訓練對象的密度,計算第三損失函式,並根據所述第三損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

13.如權利要求9所述的視頻監控設備,其中所述數量確定模組基於預定模型或預定算法,確定所述視頻數據中的所述至少一幀中的前景數據和背景數據,並且將所述前景數據輸入至所述第一神經網路,從而確定所述前景數據中每個像素點的對象數量信息。

14.如權利要求9所述的視頻監控設備,其中,所述至少一幀為所述視頻數據中的全部圖像幀;或者,所述至少一幀為所述視頻數據中的部分圖像幀,並且當所述至少一幀中的幀數大於等於三幀時相鄰的各幀之間的時間間隔相同。

15.如權利要求9所述的視頻監控設備,其中,所述密度確定模組在確定所述至少一幀中每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息;和/或,所述密度確定模組在預測所述待預測幀中的每個像素點的對象密度信息的操作中,所基於的所述至少一幀中的所述對象數量信息為通過執行平滑操作得到的修正後的對象數量信息。

16.如權利要求9到15的任一項所述的視頻監控設備,還包括:信息生成模組,用於在所述至少一幀或所述至少一幀之後的待預測幀的所述對象密度信息指示所述對象密度超過預定閾值時,生成提示信息。

實施方式

如圖1所示,根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法包括以下步驟。

在步驟S101中,獲取經由視頻數據採集模組採集的視頻數據。在《視頻監控方法和視頻監控設備》的一個實施例中,可以在視頻監控場景中配置能夠獲取監控場景的視頻數據的監控攝像頭(諸如RGB攝像頭或深度攝像頭)作為視頻數據採集模組,所述監控攝像頭可以以一定俯視視角監控當前場景。獲取經由視頻數據採集模組採集的視頻數據包括但不限於,在由物理位置上分離配置的視頻數據採集模組採集視頻數據之後,經由有線或者無線方式,接收從所述視頻數據採集模組傳送的視頻數據。可替代地,視頻數據採集模組可以與視頻監控設備中的其他模組或組件物理上位於同一位置甚至位於同一機殼內部,視頻監控設備中的其他模組或組件經由內部匯流排接收從所述視頻數據採集模組傳送的視頻數據。此後,處理進到步驟S102。

在步驟S102中,將視頻數據的至少一幀輸入至預先訓練的第一神經網路,以確定至少一幀中每個像素點的對象數量信息。

在《視頻監控方法和視頻監控設備》的一個實施例中,所述第一神經網路是卷積神經網路(CNN)。預先基於一定量的訓練數據,訓練獲得基於像素級的對象數量模型。以下,將參照附圖進一步詳細描述對於訓練數據的標註以及相應的訓練處理。

更具體地,在《視頻監控方法和視頻監控設備》的一個實施例中,在將視頻數據的至少一幀輸入至預先訓練的第一神經網路之後,可以基於預定模型確定所述至少一幀中的前景數據和背景數據。例如,可以基於預定模型對所述監控區域中的每個像素點進行機率估計,以獲取每個像素點的機率模型。在《視頻監控方法和視頻監控設備》的一個實施例中,利用多高斯模型對單個像素進行機率估計,得到每個像素點的機率模型,以此模型來針對獲取的視頻數據判斷前景數據和背景數據。在配置用於監控的場景之後,所述機率模型是視頻數據是背景數據的機率。由於背景是相對固定的,前景是任意的,則不同於背景數據的像素提取的特徵即為前景數據。

可替代地,在所述視頻數據包括深度信息的情況下,可以基於預定算法,確定所述至少一幀中的前景數據和背景數據。具體地,所述預定算法包括:獲取所述視頻數據的每個像素點的當前深度信息與相應的所述背景深度信息的深度信息差,確定包括所述深度信息差大於第一預定閾值的像素點的區域為前景候選區域;對所述前景候選區域的視頻數據執行中值濾波,獲取用於監控的前景區域的視頻數據。通過對於前景候選區域的視頻數據執行中值濾波,實現濾除噪聲信號的同時,能夠保護信號的邊緣,使得前景區域不被模糊。

在如上所述確定前景數據之後,將所述前景數據輸入至所述第一神經網路,從而確定所述前景數據中每個像素點的對象數量信息。如此,可以極大地減少所需的運算量,並且避免在背景上得到錯誤的判斷估計值。

在《視頻監控方法和視頻監控設備》的一個實施例中,為了進一步提高視頻監控的實時反應,可以通過使用隔幀採樣的方式進行對象數量判斷。由於視頻數據多幀之間的變化往往不會很大,可以使用隔幀(例如,每隔5幀)採樣運算。也就是說,所述至少一幀可以為所述視頻數據中的全部圖像幀,即執行連續幀採樣運算。或者,所述至少一幀為所述視頻數據中的部分圖像幀,即執行隔幀採樣運算。當所述至少一幀中的幀數大於等於三幀時相鄰的各幀之間的時間間隔相同,即以均勻的採樣間隔執行隔幀採樣運算。

在步驟S102中獲得單個幀中每個像素點的對象數量信息之後,處理進到步驟S103。

在步驟S103中,利用預先訓練的第二神經網路執行如下操作的至少一個:基於至少一幀中的對象數量信息執行平滑操作以修正對象數量信息;基於視頻數據的採集場景的場景信息和至少一幀中的對象數量信息,確定至少一幀中每個像素點的對象密度信息;基於視頻數據的採集場景的場景信息、至少一幀中的對象數量信息以及至少一幀與至少一幀後的待預測幀之間的時間關係信息,預測待預測幀中的每個像素點的對象密度信息。

在《視頻監控方法和視頻監控設備》的一個實施例中,所述第二神經網路是反饋神經網路(RNN)。與所述第一神經網路的訓練類似,預先基於一定量的訓練數據,並且根據所述第二神經網路的監測目的,執行相應的訓練處理。以下,將參照附圖進一步詳細描述對於訓練數據的標註以及相應的訓練處理。

更具體地,在《視頻監控方法和視頻監控設備》的一個實施例中,在所述第二神經網路接收到從所述第一神經網路輸入的至少一幀中每個像素點的對象數量信息之後,可以進一步對於所述至少一幀的各個位置的輸出進行平滑操作,以便獲得修正的對象數量信息。

進一步地,在《視頻監控方法和視頻監控設備》的一個實施例中,在所述第二神經網路接收到從所述第一神經網路輸入的所述至少一幀中每個像素點的對象數量信息之後,可以進一步基於視頻數據的採集場景的場景信息(例如,場景的物理幾何信息、監控攝像頭的視角、物理焦距等信息),從對象數量信息確定所述至少一幀中每個像素點的對象密度信息。在一個實施例中,所述每個像素點的訓練對象的密度可以通過對應像素點處的訓練對象的數量與所在場景的場景信息點乘之後獲得。可替代地,在確定對象密度信息中使用的對象數量信息可以是已經對於所述至少一幀的各個位置的輸出進行平滑操作後獲得的修正的對象數量信息。

進一步地,在《視頻監控方法和視頻監控設備》的一個實施例中,在所述第二神經網路接收到從所述第一神經網路輸入的所述至少一幀中每個像素點的對象數量信息之後,可以進一步基於視頻數據的採集場景的場景信息(例如,場景的物理幾何信息、監控攝像頭的視角、物理焦距等信息),以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,例如時間關係信息,從對象數量信息預測待預測幀中的每個像素點的對象密度信息。例如,在輸入第t幀的每個像素點的對象數量信息之後,可以預測獲得第(t+K)幀的對象密度信息,可以離散取值K=1000、2000等。

在步驟S103中獲得的所述至少一幀或其後某一時刻的待預測幀的對象密度信息可以用於警報信息的產生。在所述至少一幀的對象密度信息或者其後某一時刻的待預測幀的對象密度信息大於預先設定的預定閾值時,即顯示場景中的對象密度過大,可能存在出現踩踏等安全事件的風險,生成警報信息。

上述根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法,通過預先訓練對場景中的每個位置來做量化的密度估計的神經網路,實現了不依賴於場景的人群密度估計。以下,將參照圖2進一步描述執行上述視頻監控方法的一種視頻監控設備。

圖2是圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的功能性框圖。如圖2所示,根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備20包括視頻數據獲取模組21、數量確定模組22和密度確定模組23。

具體地,所述視頻數據獲取模組21用於獲取採集場景的視頻數據。在《視頻監控方法和視頻監控設備》的一個實施例中,可以在視頻監控場景中配置能夠獲取監控場景的視頻數據的監控攝像頭(諸如RGB攝像頭或深度攝像頭)作為所述視頻數據採集模組21,所述監控攝像頭可以以一定俯視視角監控當前場景。所述視頻數據獲取模組21可以與其後的數量確定模組22和密度確定模組23等物理位置上分離分配,並且經由有線或者無線方式,從所述視頻數據採集模組21傳送視頻數據給其後的各模組。可替代地,所述視頻數據採集模組21可以與視頻監控設備20中的其他模組或組件物理上位於同一位置甚至位於同一機殼內部,視頻監控設備20中的其他模組或組件經由內部匯流排接收從所述視頻數據採集模組21傳送的視頻數據。

所述數量確定模組22將所述視頻數據中的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息。如上所述,所述數量確定模組22所利用的第一神經網路包括卷積神經網路(CNN),並且預先基於一定量的訓練數據,訓練獲得基於像素級的對象數量模型。

所述數量確定模組22基於預定模型確定所述至少一幀中的前景數據和背景數據。例如,所述數量確定模組22可以基於預定模型對所述監控區域中的每個像素點進行機率估計,以獲取每個像素點的機率模型。在《視頻監控方法和視頻監控設備》的一個實施例中,利用多高斯模型對單個像素進行機率估計,得到每個像素點的機率模型,以此模型來針對獲取的視頻數據判斷前景數據和背景數據。在配置用於監控的場景之後,所述機率模型是視頻數據是背景數據的機率。由於背景是相對固定的,前景是任意的,則不同於背景數據的即為前景數據。

可替代地,在所述視頻數據包括深度信息的情況下,所述數量確定模組22可以基於預定算法,確定所述至少一幀中的前景數據和背景數據。具體地,所述預定算法包括:獲取所述視頻數據的每個像素點的當前深度信息與相應的所述背景深度信息的深度信息差,確定包括所述深度信息差大於第一預定閾值的像素點的區域為前景候選區域;對所述前景候選區域的視頻數據執行中值濾波,獲取用於監控的前景區域的視頻數據。通過對於前景候選區域的視頻數據執行中值濾波,實現濾除噪聲信號的同時,能夠保護信號的邊緣,使得前景區域不被模糊。在如上所述確定前景數據之後,將所述前景數據輸入至所述第一神經網路,從而確定所述前景數據中每個像素點的對象數量信息。如此,可以極大地減少所需的運算量,並且避免在背景上得到錯誤的判斷估計值。

在《視頻監控方法和視頻監控設備》的一個實施例中,為了進一步提高視頻監控的實時反應,所述數量確定模組22可以通過使用隔幀採樣的方式進行對象數量判斷。由於視頻數據多幀之間的變化往往不會很大,可以使用隔幀(例如,每隔5幀)採樣運算。也就是說,所述至少一幀可以為所述視頻數據中的全部圖像幀,即執行連續幀採樣運算。或者,所述至少一幀為所述視頻數據中的部分圖像幀,即執行隔幀採樣運算。當所述至少一幀中的幀數大於等於三幀時相鄰的各幀之間的時間間隔相同,即以均勻的採樣間隔執行隔幀採樣運算。

所述密度確定模組23利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的時間關係信息,預測所述待預測幀中的每個像素點的對象密度信息。

在《視頻監控方法和視頻監控設備》的一個實施例中,所述密度確定模組23利用的第二神經網路包括反饋神經網路(RNN)。與所述第一神經網路的訓練類似,預先基於一定量的訓練數據,並且根據所述第二神經網路的監測目的,執行相應的訓練處理。

更具體地,在《視頻監控方法和視頻監控設備》的一個實施例中,所述密度確定模組23接收到從所述數量確定模組22輸入的所述至少一幀中每個像素點的對象數量信息之後,可以進一步對於所述至少一幀的各個位置的輸出進行平滑操作,以便獲得修正的對象數量信息。

進一步地,在《視頻監控方法和視頻監控設備》的一個實施例中,在所述密度確定模組23接收到從所述數量確定模組22輸入的所述至少一幀中每個像素點的對象數量信息之後,可以進一步基於視頻數據的採集場景的場景信息(例如,場景的物理幾何信息、監控攝像頭的視角、物理焦距等信息),從對象數量信息確定所述至少一幀中每個像素點的對象密度信息。可替代地,在確定對象密度信息中使用的對象數量信息可以是已經對於所述至少一幀的各個位置的輸出進行平滑操作後獲得的修正的對象數量信息。

進一步地,在《視頻監控方法和視頻監控設備》的一個實施例中,在所述密度確定模組23接收到從所述數量確定模組22輸入的所述至少一幀中每個像素點的對象數量信息之後,可以進一步基於視頻數據的採集場景的場景信息(例如,場景的物理幾何信息、監控攝像頭的視角、物理焦距等信息),以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,例如,時間關係信息,從對象數量信息預測待預測幀中的每個像素點的對象密度信息。例如,在輸入第t幀的每個像素點的對象數量信息之後,可以預測獲得第(t+K)幀的對象密度信息,可以離散取值K=1000、2000等。

在如上所述描述的視頻監控設備20中,需要對於所述數量確定模組22利用的第一神經網路和所述密度確定模組23利用的第二神經網路執行預先訓練。以下,將參照圖3到圖6描述相應的訓練處理。

圖3是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理的第一流程圖。圖3所示的神經網路訓練處理的第一流程用於訓練用於確定至少一幀中每個像素點的對象數量信息的所述第一神經網路。神經網路訓練處理的第一流程包括以下步驟。

在步驟S301中,對於多個採集場景中的每個場景的視頻數據的至少一幀,利用預定形狀的標註框標註所述至少一幀中存在的訓練對象,將標註後的視頻數據作為第一訓練數據,所述第一訓練數據的每個像素點的濃度指示所述每個像素點處存在的訓練對象的數量。

參照圖4,圖4是圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理中訓練數據標註的示意圖。如圖4所示,在用於訓練的場景的視頻數據41中,利用預定形狀(例如,矩形)的標註框標註所述至少一幀中存在的訓練對象401。進一步地,將標註後的視頻數據作為第一訓練數據42,其中所述第一訓練數據42的每個像素點的濃度指示所述每個像素點處存在的訓練對象的數量。也就是說,如圖4所示,幾個訓練對象401重疊的像素點,顏色比單個訓練對象401所在的像素點和沒有標註訓練對象401的像素點的顏色更深。並且顏色越深,代表該像素點存在的訓練對象的數量越多,相應的密度越大。

返回參照圖3,在步驟S301之後,處理進到步驟S302。

在步驟S302中,將第一訓練數據的每一幀輸入至卷積神經網路,輸出第一訓練數據的每一幀中每個像素點的訓練對象的數量。此後,處理進到步驟S303。

在步驟S303中,根據輸出的訓練對象的數量和標註的訓練對象的數量,計算第一損失函式,根據第一損失函式調整卷積神經網路的參數,以得到訓練好的第一神經網路。

通過圖3所示的神經網路訓練處理的第一流程,經由大量訓練數據的反覆疊代訓練,獲得用於根據《視頻監控方法和視頻監控設備》的實施例的視頻監控設備的第一神經網路。

圖5是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理的第二流程圖。圖5所示的神經網路訓練處理的第二流程用於訓練用於從對象數量信息確定至少一幀中每個像素點的對象密度信息的所述第二神經網路。神經網路訓練處理的第二流程包括以下步驟。

在步驟S501中,對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有至少一幀中存在的訓練對象的數量的視頻數據作為第二訓練數據,並根據每個場景的場景信息標註第二訓練數據中每個像素點的訓練對象的密度。在一個實施例中,所述每個像素點的訓練對象的密度可以通過對應像素點處的訓練對象的數量與所在場景的場景信息點乘之後獲得。其中,所述場景信息可以包括場景的物理幾何信息、監控攝像頭的視角、物理焦距等信息。此後,處理進到步驟S502。

在步驟S502中,將第二訓練數據的每一幀輸入至第二神經網路,並根據每一幀的之前幀中的每個像素點的訓練對象的數量以及每個場景的場景信息,輸出第二訓練數據的每一幀中每個像素點的訓練對象數的密度。此後,處理進到步驟S503。

在步驟S503中,根據每一幀的輸出的訓練對象的密度和第二訓練數據中的對應幀中的標註的訓練對象的密度,計算第二損失函式。此後,處理進到步驟S504。

在步驟S504中,根據第二損失函式調整第二神經網路的參數,以得到訓練好的第二神經網路。

通過圖5所示的神經網路訓練處理的第二流程,經由大量訓練數據的反覆疊代訓練,獲得用於根據《視頻監控方法和視頻監控設備》的實施例的視頻監控設備的第二神經網路,並且該第二神經網路用於確定從第一神經網路輸出的至少一幀中每個像素點的對象密度信息。

圖6是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法中的神經網路訓練處理的第三流程圖。圖6所示的神經網路訓練處理的第三流程用於訓練用於從對象數量信息確定從第一神經網路輸出的至少一幀後的待預測幀中的每個像素點的對象密度信息的第二神經網路。神經網路訓練處理的第三流程包括以下步驟。

在步驟S601中,對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有至少一幀中存在的訓練對象的數量的視頻數據作為第三訓練數據,並根據每個場景的場景信息標註第三訓練數據中每個像素點的訓練對象的密度。此後,處理進到步驟S602。

在步驟S602中,將第三訓練數據的每一幀輸入至第二神經網路,並根據每一幀的之前幀中的每個像素點的訓練對象的數量以及每個場景的場景信息,輸出第二訓練數據的每一幀之後的待預測幀中每個像素點的訓練對象數的密度。此後,處理進到步驟S603。

在步驟S603中,根據輸出的待預測幀中每個像素點的訓練對象的密度和第三訓練數據中的對應幀中標註的訓練對象的密度,計算第三損失函式。此後,處理進到步驟S604。

在步驟S604中,根據第三損失函式調整第二神經網路的參數,以得到訓練好的第二神經網路。

通過圖6所示的神經網路訓練處理的第三流程,經由大量訓練數據的反覆疊代訓練,獲得用於根據《視頻監控方法和視頻監控設備》的實施例的視頻監控設備的第二神經網路,並且該第二神經網路用於確定從第一神經網路輸出的至少一幀後的待預測幀中的每個像素點的對象密度信息。

圖7是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的功能性框圖。與以上參照圖2描述的視頻監控設備20相比,如圖7所示的視頻監控設備70除了包括視頻數據獲取模組21、數量確定模組22和密度確定模組23之外,進一步包括第一訓練模組24、第二訓練模組25、第三訓練模組26和信息生成模組27。對於視頻數據獲取模組21、數量確定模組22和密度確定模組23,在此將省略其重複描述。

所述第一訓練模組24用於預先訓練確定視頻數據中至少一幀中每個像素點的對象數量信息的所述第一神經網路。所述第一訓練模組24的訓練處理採用參照圖3描述的流程,在此將省略其重複描述。

所述第二訓練模組25用於預先訓練確定視頻數據中至少一幀中每個像素點的對象密度信息的所述第二神經網路。所述第二訓練模組25的訓練處理採用參照圖5描述的流程,在此將省略其重複描述。

所述第三練模組26用於預先訓練確定視頻數據中至少一幀後的待預測幀中的每個像素點的對象密度信息的第二神經網路。所述第三訓練模組26的訓練處理採用參照圖6描述的流程,在此將省略其重複描述。

所述信息生成模組27在所述至少一幀或所述至少一幀之後的待預測幀的所述對象密度信息指示所述對象密度超過預定閾值時,生成提示信息。通過配置有所述信息生成模組27,在所述至少一幀的對象密度信息或者其後某一時刻的待預測幀的對象密度信息大於預先設定的預定閾值時,即顯示場景中的對象密度過大,可能存在出現踩踏等安全事件的風險,生成提示信息。

圖8是進一步圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法的流程圖。如圖8所示的視頻監控方法可以由以上參照圖7描述的視頻監控設備執行。具體地,根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法包括以下步驟。

在步驟S801中,訓練第一神經網路和第二神經網路。在《視頻監控方法和視頻監控設備》的實施例中,可以由所述第一訓練模組24、第二訓練模組25、第三訓練模組26,利用分別參照圖3、圖5和圖6描述的訓練處理過程,訓練第一和第二神經網路。此後,處理進到步驟S802。

在步驟S802中,獲取經由視頻數據採集模組採集的視頻數據。步驟S802的處理與以上參照圖2描述的步驟S201相同,在此將省略其重複描述。此後,處理進到步驟S803。

在步驟S803中,基於預定模型或預定算法,確定視頻數據中的至少一幀中的前景數據和背景數據。在《視頻監控方法和視頻監控設備》的實施例中,在將視頻數據的至少一幀輸入至預先訓練的第一神經網路之後,可以基於預定模型或預定算法確定所述至少一幀中的前景數據和背景數據。例如,可以基於預定模型對所述監控區域中的每個像素點進行機率估計,以獲取每個像素點的機率模型。在《視頻監控方法和視頻監控設備》的一個實施例中,利用多高斯模型對單個像素進行機率估計,得到每個像素點的機率模型,以此模型來針對獲取的視頻數據判斷前景數據和背景數據。在配置用於監控的場景之後,所述機率模型是視頻數據是背景數據的機率。由於背景是相對固定的,前景是任意的,則不同於背景數據的即為前景數據。在所述視頻數據包括深度信息的情況下,可以基於預定算法,確定所述至少一幀中的前景數據和背景數據。具體地,所述預定算法包括:獲取所述視頻數據的每個像素點的當前深度信息與相應的所述背景深度信息的深度信息差,確定包括所述深度信息差大於第一預定閾值的像素點的區域為前景候選區域;對所述前景候選區域的視頻數據執行中值濾波,獲取用於監控的前景區域的視頻數據。此後,處理進到步驟S804。

步驟S804和步驟S805的處理與以上參照圖1描述的步驟S102和S103分別相同,在此將省略其重複描述。此後,處理進到步驟S806。

在步驟S806中,在所述至少一幀或所述至少一幀之後的待預測幀的對象密度信息指示對象密度超過預定閾值時,生成提示信息。

圖9是圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的示意性框圖。

圖9是圖示根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的示意性框圖。如圖9所示,根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備90包括:處理器91、存儲器92、以及在所述存儲器92的中存儲的電腦程式指令93。

所述電腦程式指令93在所述處理器91運行時可以實現根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備的各個功能模組的功能,並且/或者可以執行根據《視頻監控方法和視頻監控設備》實施例的視頻監控方法的各個步驟。

具體地,在所述電腦程式指令93被所述處理器91運行時,可以使得視頻監控設備90執行以下步驟:獲取經由視頻數據採集模組採集的視頻數據;將所述視頻數據的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息;以及利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,預測所述待預測幀中的每個像素點的對象密度信息。

此外,在所述電腦程式指令93被所述處理器91運行時,可以使得視頻監控設備90執行:訓練所述第一神經網路,其中,所述訓練所述第一神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,利用預定形狀的標註框標註所述至少一幀中存在的訓練對象,將標註後的視頻數據作為第一訓練數據,所述第一訓練數據的每個像素點的濃度指示所述每個像素點處存在的訓練對象的數量;以及將所述第一訓練數據的每一幀輸入至卷積神經網路,輸出所述第一訓練數據的每一幀中每個像素點的所述訓練對象的數量;根據輸出的所述訓練對象的數量和標註的所述訓練對象的數量,計算第一損失函式,根據所述第一損失函式調整所述卷積神經網路的參數,以得到訓練好的所述第一神經網路。

此外,在所述電腦程式指令93被所述處理器91運行時,可以使得視頻監控設備90執行:訓練所述第二神經網路,其中,所述訓練所述第二神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第二訓練數據,並根據每個場景的場景信息標註所述第二訓練數據中每個像素點的訓練對象的密度;將所述第二訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述第二訓練數據的所述每一幀中每個像素點的訓練對象數的密度;根據每一幀的輸出的訓練對象的密度和所述第二訓練數據中的對應幀中的標註的訓練對象的密度,計算第二損失函式;根據所述第二損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

此外,在所述電腦程式指令93被所述處理器91運行時,可以使得視頻監控設備90執行:訓練所述第二神經網路,其中,所述訓練所述第二神經網路包括:對於多個採集場景中的每個場景的視頻數據的至少一幀,以標註有所述至少一幀中存在的訓練對象的數量的視頻數據作為第三訓練數據,並根據每個場景的場景信息標註所述第三訓練數據中每個像素點的訓練對象的密度;將所述第三訓練數據的每一幀輸入至第二神經網路,並根據所述每一幀的之前幀中的每個像素點處的所述訓練對象的數量以及所述每個場景的場景信息,輸出所述每一幀之後的待預測幀中每個像素點的訓練對象數量的密度;根據輸出的所述待預測幀中每個像素點的訓練對象的密度和所述第三訓練數據中的對應幀中標註的訓練對象的密度,計算第三損失函式;根據所述第三損失函式調整所述第二神經網路的參數,以得到訓練好的第二神經網路。

此外,在所述電腦程式指令93被所述處理器91運行時,可以使得視頻監控設備90執行:基於預定模型或預定算法,確定所述至少一幀中的前景數據和背景數據,以及將所述前景數據輸入至所述第一神經網路,從而確定所述前景數據中每個像素點的對象數量信息。

此外,在所述電腦程式指令93被所述處理器91運行時,可以使得視頻監控設備90執行:在所述至少一幀或所述至少一幀之後的待預測幀的所述對象密度信息指示所述對象密度超過預定閾值時,生成提示信息。

根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備中的各模組可以通過根據《視頻監控方法和視頻監控設備》實施例的視頻監控設備中的處理器運行在存儲器中存儲的電腦程式指令來實現,或者可以在根據《視頻監控方法和視頻監控設備》實施例的電腦程式產品的計算機可讀存儲介質中存儲的計算機指令被計算機運行時實現。

所述計算機可讀存儲介質例如可以包括智慧型電話的存儲卡、平板電腦的存儲部件、個人計算機的硬碟、隨機存取存儲器(RAM)、唯讀存儲器(ROM)、可擦除可程式唯讀存儲器(EPROM)、攜帶型緊緻盤唯讀存儲器(CD-ROM)、USB存儲器、或者上述存儲介質的任意組合。

根據《視頻監控方法和視頻監控設備》的又一個實施例,提供了一種電腦程式產品,包括計算機可讀存儲介質,在所述計算機可讀存儲介質上存儲了電腦程式指令,所述電腦程式指令在被計算機運行時,使得所述計算機執行以下步驟:

獲取經由視頻數據採集模組採集的視頻數據;將所述視頻數據的至少一幀輸入至預先訓練的第一神經網路,以確定所述至少一幀中每個像素點的對象數量信息;以及利用預先訓練的第二神經網路執行如下操作中的至少一個:基於所述至少一幀中的所述對象數量信息執行平滑操作以修正所述對象數量信息;基於所述視頻數據的採集場景的場景信息和所述至少一幀中的所述對象數量信息,確定所述至少一幀中每個像素點的對象密度信息;以及基於所述視頻數據的採集場景的場景信息、所述至少一幀中的所述對象數量信息以及所述至少一幀與所述至少一幀後的待預測幀之間的關聯信息,預測所述待預測幀中的每個像素點的對象密度信息。

專利榮譽

2021年6月24日,《視頻監控方法和視頻監控設備》獲得第二十二屆中國專利銀獎。